Fiks server-lagring av Siri-opptak

Det har vist seg at Apple lar innleide aktører lytte til et fåtall av Siri-kall i forbindelse med kvalitetssikringen. Selv om opptakene kun er korte kan de ha privat karakter.

Apples digitale assistent Siri lytter til deg gjennom din iPhone.

Som forventet, dersom du har "Hei, Siri" aktivert. Men visste du at lyden av en glidelås som åpnes kan mistolkes av den kunstige intelligense, og at påfølgende akustisk aktivitet kan sendes til Apples servere for analyse?

Siri og personvern

Det synes ikke som om det er nevneverdig grunn til å krisemaksimere de senere dagers nyheter om at Apple transskriberer et mindretall av Siri-kall som lander på deres servere. Det er snakk om cirka 1% av forekomstene, og i mange tilfeller kun noen få sekunder.

Hensikten er å sikre at talegjenkjenningen fungerer korrekt, noe som gjøres ved at personer skriver ned lydopptakene.

Der du bruker Siri til å sette en timer for bløtkokte egg så bør ikke det by på kritiske personvern-vurderinger, men i enkelte tilfeller viser det seg altså at opptaksfunksjonen har blitt aktivert også uten at brukeren har ønsket det. Det skal være eksempler på konfidensielle samtaler med en lege (fornavn Siri?), eksempler på kriminelle handlinger, eller også sex.

Sveitsiske Jan Kaiser, medlem av EFF, har vist at man enkelt kan installere en iOS-profil der lagring av Siri-kall på serveren avvises. Installeringen er såre enkel, og for de som ønsker det er det også mulig å lage sin egen profil via Apple Configurator.

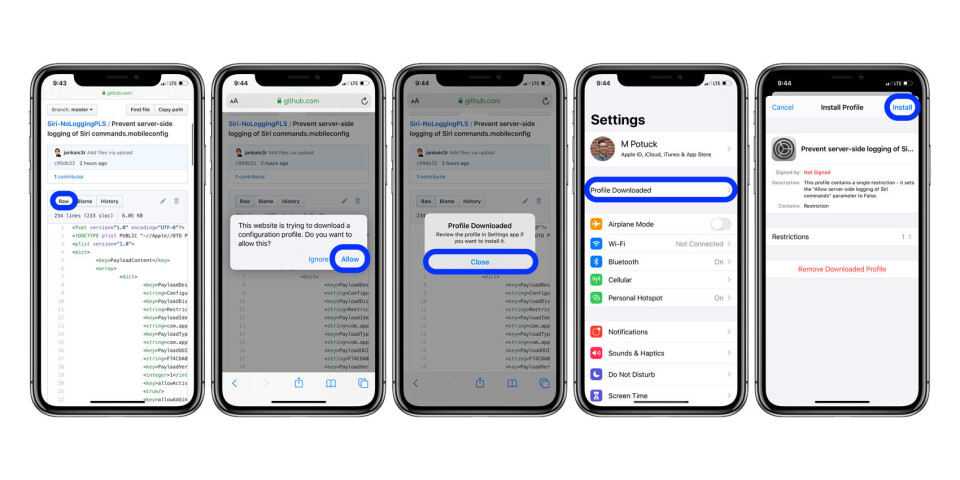

Fremgangsmåten som beskrives av 9to5Mac er som følger (se bildet over saken til sammenlikning):

- Fra en iPhone eller iPad gå til GitHub-adressen vi har lenket til under for å installere Prevent server-side logging of Siri commands.mobileconfig.

- Velg Raw-visning, og tillat å laste ned profilen i varslingen som vises.

- Gå til Innstillinger og gå inn på profilen og velg så Installer.

Du finner profilen til nedlasting fra Jan Kaisers GitHub her.

Via 9to5Mac og Jan Kaiser